Si el Rey de Suecia quiere ayuda para escribir su discurso anual de Navidad este año, podría pedir el mismo modelo de IA que está disponible para sus 10 millones de súbditos.

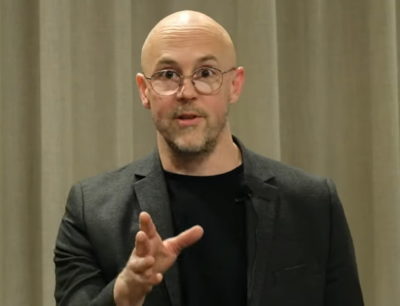

Como prueba, los investigadores solicitaron que el modelo (llamado GPT-SW3) escribiera un borrador para un discurso real e hizo un muy buen trabajo, según Magnus Sahlgren, quien lidera la investigación en comprensión de idiomas naturales de AI Sweden, un consorcio que impulsa la introducción del país a la era del machine learning.

«Más tarde, nuestro ministro de digitalización nos visitó y solicitó que el modelo que generara argumentos para las posiciones políticas y se le ocurrieron algunos realmente inteligentes, y él entendió intuitivamente cómo dar las instrucciones correctas para que el modelo generara buenos textos», dijo Sahlgren.

Los primeros logros inspiraron la creación de una versión aún más grande y potente del modelo de idiomas, que esperan que esté al alcance de cualquier ciudadano, empresa o agencia del gobierno en Escandinavia.

Un Modelo Multilingüe

La versión actual contiene 3600 millones de parámetros y es lo suficientemente inteligente como para hacer cosas geniales en Suecia. El objetivo del equipo de Sahlgren es entrenar un modelo de vanguardia con 175,000 millones de parámetros que pueden manejar todo tipo de tareas lingüísticas en los idiomas nórdicos de Suecia, Dinamarca, Noruega y, esperan, también de Islandia.

Por ejemplo, una startup puede usarla para generar automáticamente descripciones de productos para un sitio web de comercio electrónico con solo darle los nombres de los productos. Las agencias gubernamentales pueden usarla para clasificar y orientar rápidamente preguntas de los ciudadanos.

Las empresas pueden pedirle que resuma rápidamente informes para que puedan reaccionar rápidamente. Los hospitales pueden ejecutar versiones puras del modelo de forma privada en sus propios sistemas para mejorar la atención al paciente.

«Es un modelo fundacional que proporcionaremos como servicio para cualquier tarea que la gente quiera resolver», dijo Sahlgren, quien ha estado trabajando en la aplicación de machine learning en el campo lingüístico desde que obtuvo su doctorado en comunicación computacional en 2006.

Permiso para Hablar Libremente

Es una capacidad que cada vez más se considera un recurso estratégico, una piedra clave de la soberanía digital en un mundo que habla miles de idiomas en casi 200 países.

Hoy en día, la mayoría de los servicios de idiomas se centran en el chino o el inglés, las dos lenguas más habladas del mundo. Por lo general, se crean en China o en EE. UU., y no son gratis.

«Es importante que tengamos modelos construidos en Suecia para Suecia», dijo Sahlgren.

Equipo Pequeño, Sistema Gigante

«Somos un país pequeño y tenemos un equipo central de alrededor de seis personas; sin embargo, podemos construir una herramienta de vanguardia como esta para que la usen la gente», agregó.

Esto se debe a que Suecia tiene un potente motor llamado BerzeLiUs, una supercomputadora de IA de 300 petaflops de la Universidad de Linköping. Entrenó el modelo GPT-SW3 inicial usando solo 16 de los 60 nodos del NVIDIA DGX SuperPOD.

Puede que el próximo modelo use todos los nodos del sistema. Estos trabajos superintensos requieren un supersoftware como el framework NVIDIA NeMo Megatron.

«Nos permite escalar nuestro entrenamiento a toda la supercomputadora y tuvimos la suerte de tener acceso a expertos en el equipo de desarrollo de NeMo; sin NVIDIA habría sido mucho más complicado avanzar tanto», dijo.

Un Workflow para Cualquier Idioma

Los ingenieros de NVIDIA crearon una formula basada en NeMo y un proceso emergente llamado «p-tuning», que optimiza modelos enormes rápidamente y está orientado a trabajar con cualquier lenguaje.

En una de las primeras pruebas, un modelo casi duplicó su precisión después de que los ingenieros de NVIDIA aplicaron las técnicas.

Además, requiere una décima parte de los datos, lo que reduce la necesidad de usar decenas de miles de registros etiquetados a mano. Esto permite a los usuarios afinar un modelo con los conjuntos de datos relativamente pequeños y específicos de la industria que tengan a mano.

«Esperamos inspirar muchas iniciativas en la industria, en las startups y en el público general que usen nuestra tecnología para desarrollar sus propias aplicaciones y servicios», dijo Sahlgren.

Escribir el Próximo Capítulo

Mientras tanto, los desarrolladores de NVIDIA ya están trabajando en formas de mejorar el software habilitante.

Una prueba demostró ser prometedora para entrenar nuevas capacidades usando conjuntos de datos en inglés ampliamente disponibles en modelos diseñados para cualquier idioma. Otra iniciativa aplica las técnicas de p-tuning en trabajos de inferencia para que los modelos puedan aprender sobre la marcha.

Zenodia Charpy, una arquitecta de soluciones sénior de NVIDIA radicada en Gotemburgo, comparte el entusiasmo del equipo de AI Sweden que apoya. «Recién hemos comenzado a probar nuevos y mejores métodos para abordar estos grandes desafíos lingüísticos; hay mucho más por venir», dijo.

El modelo GPT-SW3 estará disponible a finales de año a través de un programa de acceso anticipado. Para postularte, escribe a francisca.hoyer@ai.se.