A medida que la IA generativa y los grandes modelos de lenguaje (LLM) continúan impulsando innovaciones, los requisitos de computación para el entrenamiento y la inferencia han crecido a un ritmo asombroso.

Para satisfacer esa necesidad, Google Cloud anunció la disponibilidad general de sus nuevas instancias A3, impulsadas por las GPU NVIDIA H100 Tensor Core. Estas GPU ofrecen un rendimiento sin precedentes a todo tipo de aplicaciones de IA con su motor Transformer, diseñado específicamente para acelerar los LLM.

La disponibilidad de las instancias A3 se produce inmediatamente después de que NVIDIA fuera nombrada Google Cloud’s Generative AI Partner of the Year, un premio que reconoce la colaboración profunda y continua de las empresas para acelerar la IA generativa en Google Cloud.

El esfuerzo conjunto adopta múltiples formas, desde el diseño de la infraestructura hasta la amplia habilitación de software, para facilitar la creación e implementación de aplicaciones de IA en la plataforma Google Cloud.

En la conferencia Google Cloud Next, el fundador y CEO de NVIDIA, Jensen Huang, se unió al CEO de Google Cloud, Thomas Kurian, en el discurso de apertura del evento para celebrar la disponibilidad general de las instancias A3 con GPU NVIDIA H100 y hablar sobre cómo Google está utilizando las GPU NVIDIA H100 y A100 para la investigación interna y la inferencia en su DeepMind y otras divisiones.

Durante la discusión, Huang señaló los niveles más profundos de colaboración que permitieron la aceleración de GPU de NVIDIA para el framework PaxML para crear LLM masivos. Este framework de machine learning basado en Jax está diseñado específicamente para entrenar modelos a gran escala, lo que permite la experimentación y la paralelización avanzadas y totalmente configurables.

PaxML ha sido utilizado por Google para construir modelos internos, incluyendo DeepMind, así como proyectos de investigación, y utilizará GPU NVIDIA. Las compañías también anunciaron que PaxML está disponible de inmediato en el registro de contenedores NVIDIA NGC.

Abundan las Startups de IA Generativa

Hoy en día, hay más de mil startups de IA generativa que crean aplicaciones de próxima generación, muchas de las cuales utilizan la tecnología NVIDIA en Google Cloud. Algunos de los más notables son Writer y Runway.

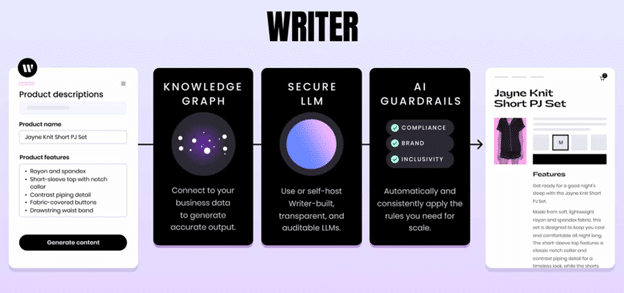

Writer utiliza LLM basados en transformers para permitir a los equipos de marketing crear rápidamente textos para páginas web, blogs, anuncios y mucho más. Para ello, la empresa aprovecha NVIDIA NeMo, un framework de aplicaciones de NVIDIA AI Enterprise que ayuda a las empresas a seleccionar sus conjuntos de datos de entrenamiento, crear y personalizar LLM y ejecutarlos en producción a escala.

Con las optimizaciones de NeMo, los desarrolladores de Writer han pasado de trabajar con modelos con cientos de millones de parámetros a modelos de 40 mil millones de parámetros. La lista de clientes de la startup incluye nombres conocidos como Deloitte, L’Oreal, Intuit, Uber y muchas otras empresas de Fortune 500.

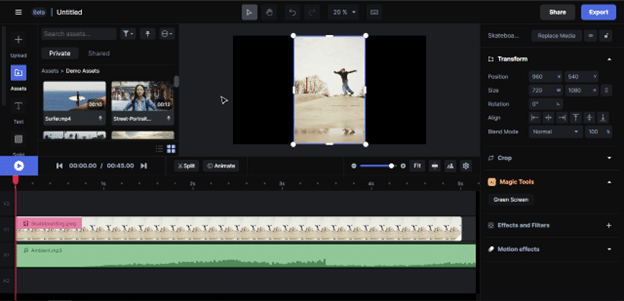

Runway utiliza IA para generar videos en cualquier estilo. El modelo de IA imita estilos específicos solicitados por imágenes dadas o a través de un mensaje de texto. Los usuarios también pueden utilizar el modelo para crear nuevo contenido de vídeo utilizando material de archivo existente. Esta flexibilidad permite a los cineastas y creadores de contenido explorar y diseñar videos de una manera completamente nueva.

Google Cloud fue el primer CSP en llevar la GPU NVIDIA L4 a la nube. Además, las compañías han colaborado para permitir que el servicio Dataproc de Google aproveche el acelerador RAPIDS para Apache Spark con el fin de proporcionar aumentos significativos de rendimiento para ETL, disponible hoy con Dataproc en Google Compute Engine y pronto para Dataproc sin servidor.

Las compañías también han hecho que NVIDIA AI Enterprise esté disponible en Google Cloud Marketplace e integrado el software de aceleración NVIDIA en el entorno de desarrollo de IA de Vertex.

Obtén más detalles sobre las instancias de GPU de NVIDIA en Google Cloud y cómo NVIDIA está impulsando la IA generativa, y descubre cómo las organizaciones ejecutan sus aplicaciones empresariales de alta prioridad con NVIDIA NeMo en Google Cloud acelerado por GPU.

Suscríbete a las noticias de IA generativa para estar al día de los últimos avances, desarrollos y tecnologías.