ChatGPT marcó el momento big bang de la IA generativa. Las respuestas se pueden generar en respuesta a casi cualquier consulta, lo que ayuda a transformar el trabajo digital, como la creación de contenido, el servicio al cliente, el desarrollo de software y las operaciones comerciales para los trabajadores del conocimiento.

La IA física, la encarnación de la inteligencia artificial en humanoides, fábricas y otros dispositivos dentro de los sistemas industriales, aún no ha experimentado su momento de ruptura.

Esto ha frenado industrias como el transporte y la movilidad, la manufactura, la logística y la robótica. Pero eso está a punto de cambiar gracias a tres computadoras que reúnen formación avanzada, simulación e inferencia.

El Auge de la IA Física Multimodal

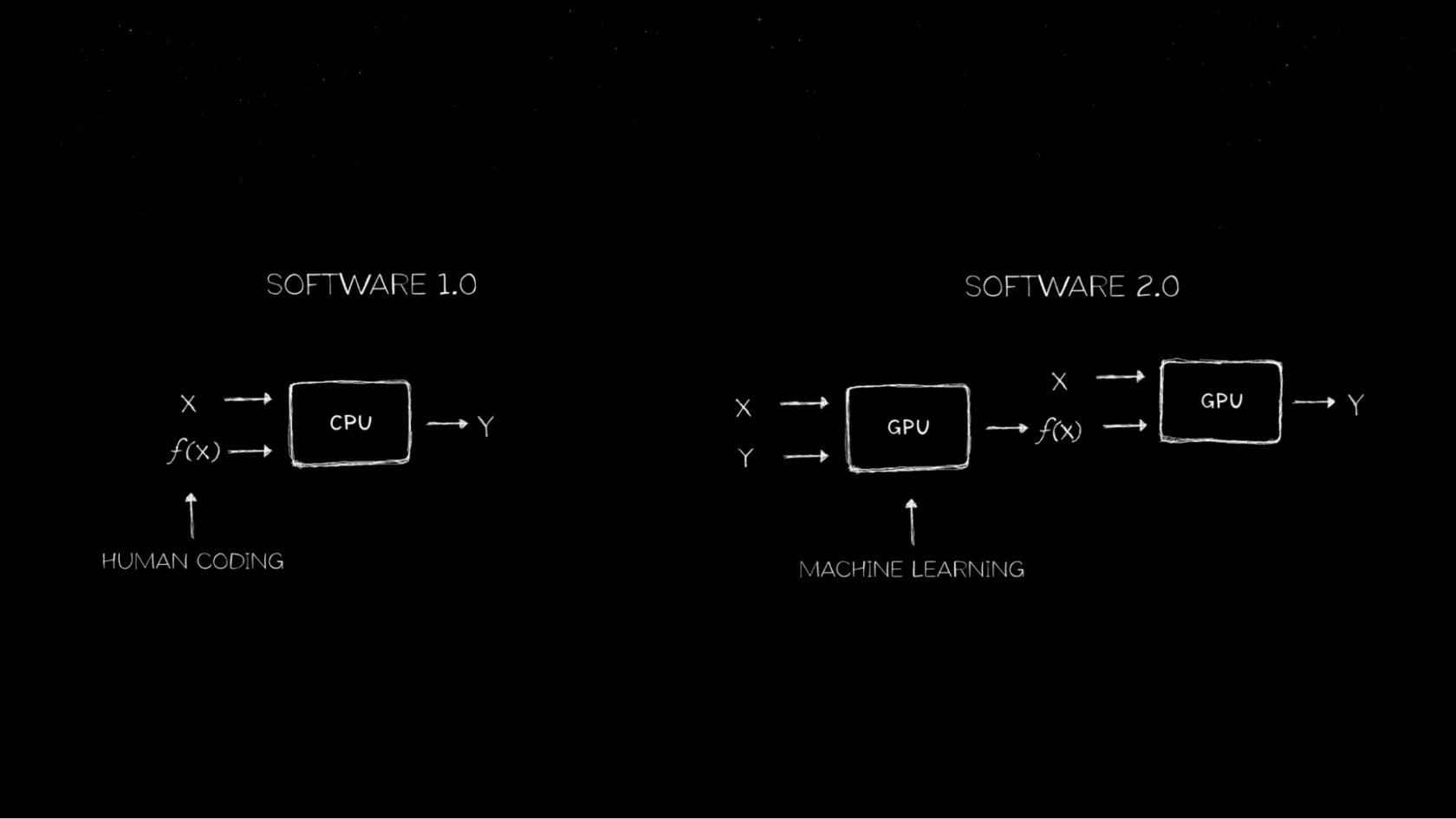

Durante 60 años, el «Software 1.0» (código de serie escrito por programadores humanos) se ejecutó en computadoras de propósito general alimentadas por CPU.

Luego, en 2012, Alex Krizhevsky, bajo la tutela de Ilya Sutskever y Geoffrey Hinton, ganó el concurso de reconocimiento de imágenes por computadora ImageNet con AlexNet, un revolucionario modelo de deep learning para la clasificación de imágenes.

Esto marcó el primer contacto de la industria con la IA. El avance del machine learning (redes neuronales que se ejecutan en GPU) impulsó la era del software 2.0.

Hoy en día, el software escribe software. Las cargas de trabajo de computación del mundo están pasando de la computación de propósito general en CPU a la computación acelerada en GPU, dejando muy atrás la ley de Moore.

Con IA generativa, se han entrenado modelos multimodales de transformers y de difusión para generar respuestas.

Los grandes modelos de lenguaje son unidimensionales, capaces de predecir el próximo token, en modos como letras o palabras. Los modelos de generación de imágenes y vídeos son bidimensionales y capaces de predecir el siguiente píxel.

Ninguno de estos modelos puede entender o interpretar el mundo tridimensional. Y ahí es donde entra en juego la IA física.

Los modelos de IA física pueden percibir, comprender, interactuar y navegar por el mundo físico con IA generativa. Con la computación acelerada, los avances de la IA física multimodal y las simulaciones físicas a gran escala están permitiendo que el mundo se dé cuenta del valor de la IA física a través de los robots.

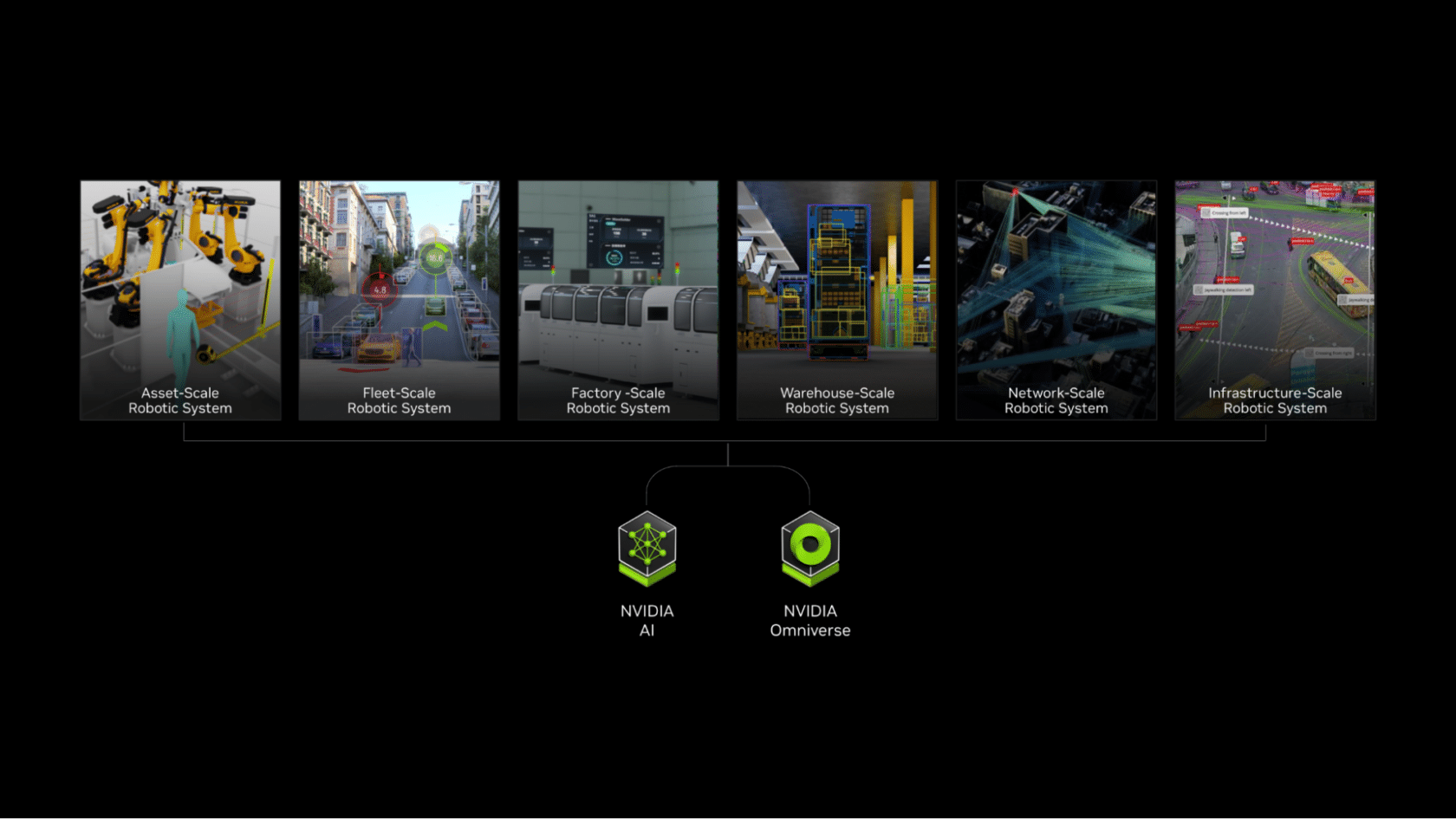

Un robot es un sistema que puede percibir, razonar, planificar, actuar y aprender. A menudo se piensa en los robots como robots móviles autónomos (AMR), brazos manipuladores o humanoides. Pero hay muchos más tipos de realizaciones robóticas.

En un futuro cercano, todo lo que se mueve, o que monitorea las cosas que se mueven, serán sistemas robóticos autónomos. Estos sistemas serán capaces de detectar y responder a sus entornos.

Todo, desde quirófanos hasta data centers, almacenes, fábricas, incluso sistemas de control de tráfico o ciudades inteligentes completas, se transformará de sistemas estáticos operados manualmente a sistemas autónomos e interactivos incorporados por IA física.

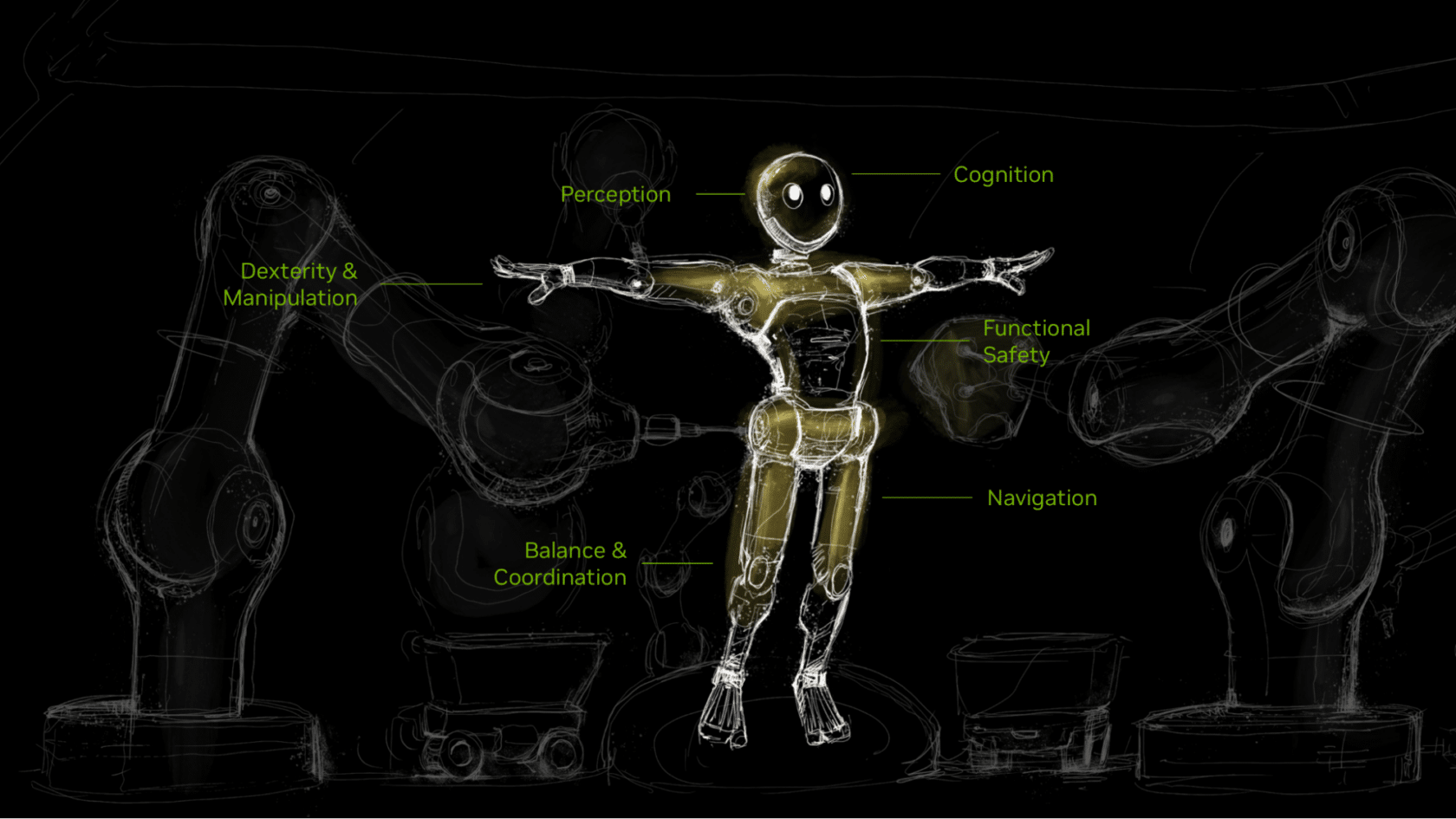

La Próxima Frontera: Robots Humanoides

Los robots humanoides son una manifestación robótica ideal de propósito general porque pueden operar de manera eficiente en entornos construidos para humanos, al tiempo que requieren ajustes mínimos para su implementación y operación.

Se espera que el mercado mundial de robots humanoides alcance los 38.000 millones de dólares en 2035, un aumento de más de seis veces con respecto a los aproximadamente 6.000 millones de dólares para el período pronosticado hace casi dos años, según Goldman Sachs.

Investigadores y desarrolladores de todo el mundo están compitiendo para construir esta próxima ola de robots.

Tres Computadoras para Desarrollar la IA Física

Para desarrollar robots humanoides, se requieren tres sistemas de computación acelerados para manejar el entrenamiento físico de la IA y los robots, la simulación y el tiempo de ejecución. Dos avances de computación están acelerando el desarrollo de robots humanoides: modelos de base multimodales y simulaciones escalables basadas en la física de robots y sus mundos.

Los avances en IA generativa están llevando la percepción, el control, la planificación de habilidades y la inteligencia en 3D a los robots. La simulación de robots a escala permite a los desarrolladores refinar, probar y optimizar las habilidades de los robots en un mundo virtual que imita las leyes de la física, lo que ayuda a reducir los costos de adquisición de datos del mundo real y garantiza que puedan funcionar en entornos seguros y controlados.

NVIDIA ha construido tres computadoras y ha acelerado plataformas de desarrollo para permitir a los desarrolladores crear IA física.

En primer lugar, los modelos se entrenan en una supercomputadora. Los desarrolladores pueden usar NVIDIA NeMo en la plataforma NVIDIA DGX para entrenar y ajustar potentes modelos de IA generativa y de base. También pueden aprovechar el Proyecto GR00T de NVIDIA, una iniciativa para desarrollar modelos de base de propósito general para robots humanoides que les permitan comprender el lenguaje natural y emular movimientos mediante la observación de las acciones humanas.

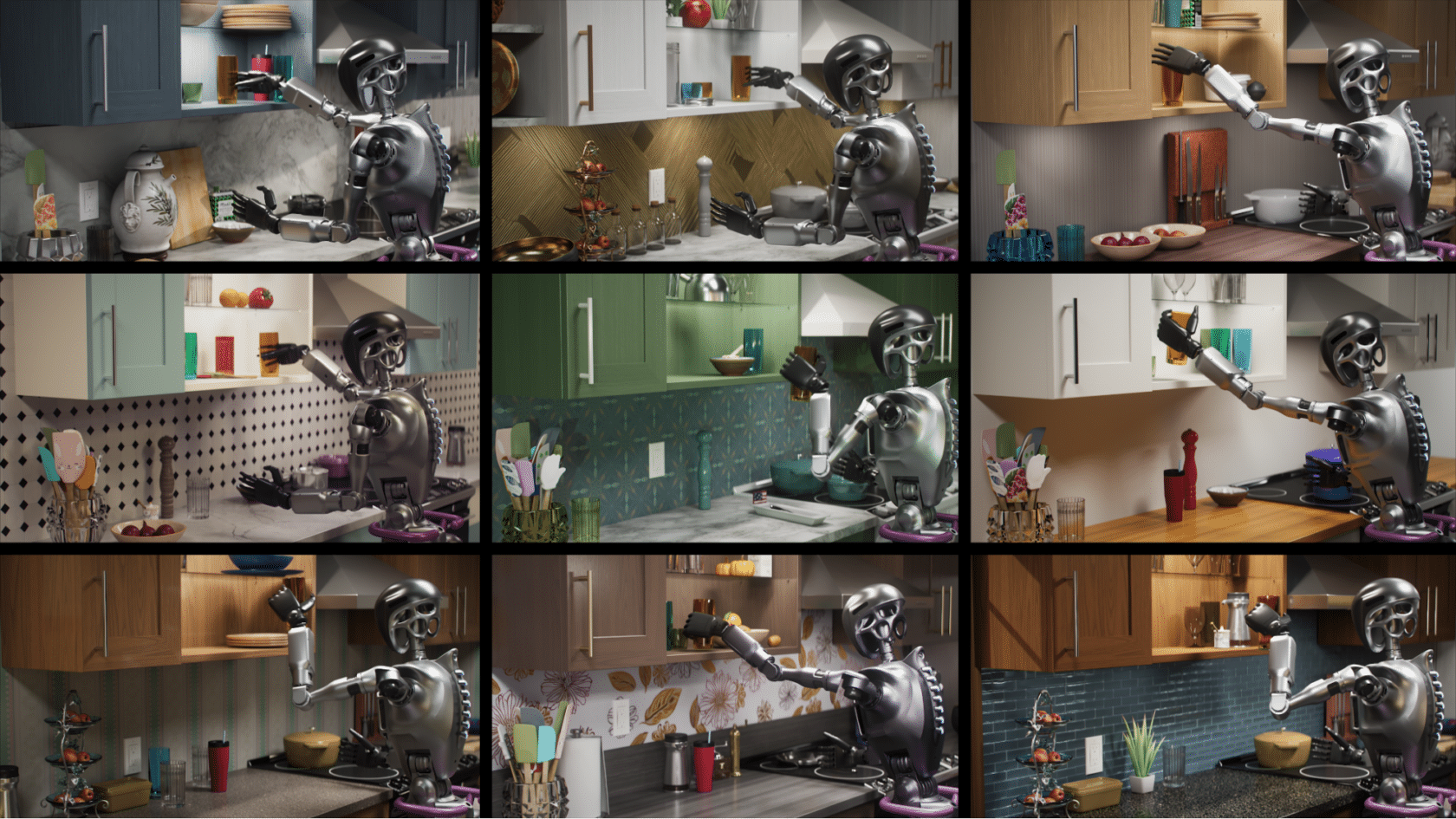

En segundo lugar, NVIDIA Omniverse, que se ejecuta en servidores NVIDIA OVX, proporciona la plataforma de desarrollo y el entorno de simulación para probar y optimizar la IA física con interfaces de programación de aplicaciones y frameworks como NVIDIA Isaac Sim.

Los desarrolladores pueden usar Isaac Sim para simular y validar modelos de robots, o generar cantidades masivas de datos sintéticos basados en la física para iniciar el entrenamiento de modelos de robots. Los investigadores y desarrolladores también pueden usar NVIDIA Isaac Lab, un framework de aprendizaje de robots de código abierto que impulsa el aprendizaje de refuerzo de robots y el aprendizaje de imitación, para ayudar a acelerar la capacitación y el refinamiento de las políticas de robots.

Por último, los modelos de IA entrenados se despliegan en un ordenador en tiempo de ejecución. Las computadoras robóticas NVIDIA Jetson Thor están diseñadas específicamente para necesidades de computación compactas a bordo. Un conjunto de modelos que consta de modelos de política de control, visión y lenguaje compone el cerebro del robot y se despliega en un sistema de computación en el edge integrado de bajo consumo.

En función de sus workflows y áreas de desafío, los fabricantes de robots y los desarrolladores de modelos de base pueden utilizar tantas plataformas y sistemas de computación acelerada como sea necesario.

Construyendo la Próxima Ola de Instalaciones Autónomas

Las instalaciones robóticas son el resultado de la culminación de todas estas tecnologías.

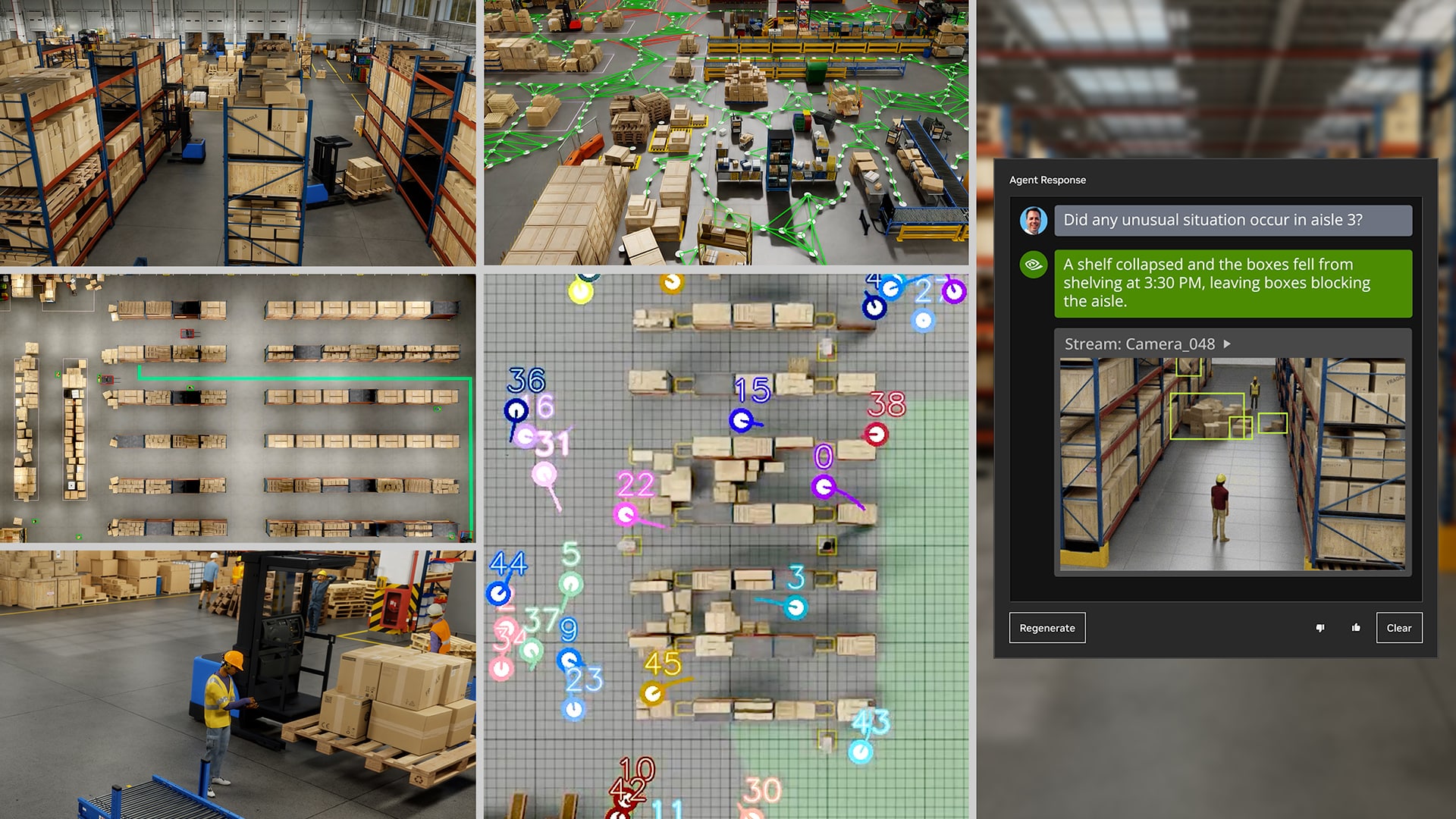

Fabricantes como Foxconn o empresas de logística como Amazon Robotics pueden orquestar equipos de robots autónomos para trabajar junto a los trabajadores humanos y monitorear las operaciones de la fábrica a través de cientos o miles de sensores.

Estos almacenes, plantas y fábricas autónomas contarán con gemelos digitales. Los gemelos digitales se utilizan para la planificación y optimización del diseño, la simulación de operaciones y, lo que es más importante, las pruebas de software de flotas de robots.

Basado en Omniverse, «Mega» es un modelo para gemelos digitales de fábrica que permite a las empresas industriales probar y optimizar sus flotas de robots en simulación antes de implementarlos en fábricas físicas. Esto ayuda a garantizar una integración perfecta, un rendimiento óptimo y una interrupción mínima.

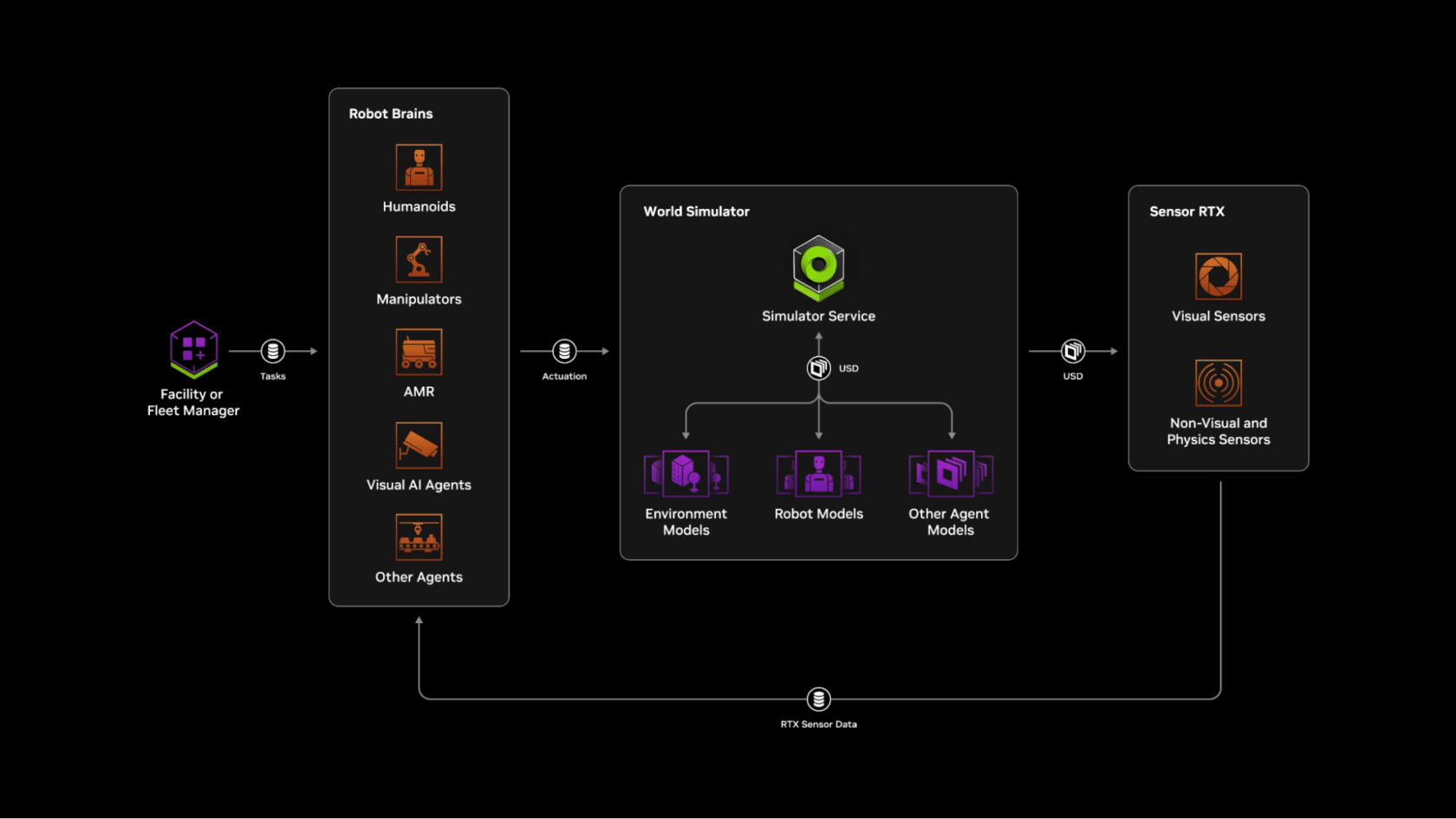

Mega permite a los desarrolladores poblar los gemelos digitales de su fábrica con robots virtuales y sus modelos de IA, o los cerebros de los robots. Los robots en el gemelo digital ejecutan tareas percibiendo su entorno, razonando, planificando su próximo movimiento y, finalmente, completando las acciones planificadas.

Estas acciones son simuladas en el entorno digital por el simulador mundial en Omniverse, y los resultados son percibidos por los cerebros del robot a través de la simulación del sensor Omniverse.

Con las simulaciones de sensores, los cerebros de los robots deciden la siguiente acción y el bucle continúa, todo mientras Mega rastrea meticulosamente el estado y la posición de cada elemento dentro del gemelo digital de fábrica.

Esta metodología avanzada de pruebas de software permite a las empresas industriales simular y validar cambios dentro de los límites seguros del gemelo digital Omniverse, lo que les ayuda a anticipar y mitigar posibles problemas para reducir el riesgo y los costos durante la implementación en el mundo real.

Potenciando el Ecosistema de Desarrolladores con la Tecnología NVIDIA

NVIDIA acelera el trabajo del ecosistema global de desarrolladores de robótica y creadores de modelos de bases de robots con tres computadoras.

Universal Robots, una empresa de Teradyne Robotics, utilizó NVIDIA Isaac Manipulator, bibliotecas aceleradas y modelos de IA de Isaac, y NVIDIA Jetson Orin para crear UR AI Accelerator, un kit de herramientas de hardware y software listo para usar que permite a los desarrolladores de cobots crear aplicaciones, acelerar el desarrollo y reducir el tiempo de comercialización de los productos de IA.

RGo Robotics utilizó NVIDIA Isaac Perceptor para ayudar a sus wheel.me AMR a trabajar en todas partes, todo el tiempo, y tomar decisiones inteligentes al brindarles una percepción e información visual-espacial similares a las humanas.

Los fabricantes de robots humanoides, incluidos 1X Technologies, Agility Robotics, Apptronik, Boston Dynamics, Fourier, Galbot, Mentee, Sanctuary AI, Unitree Robotics y XPENG Robotics, están adoptando la plataforma de desarrollo de robótica de NVIDIA.

Boston Dynamics está utilizando a Isaac Sim e Isaac Lab para construir cuadrúpedos y robots humanoides para aumentar la productividad humana, abordar la escasez de mano de obra y priorizar la seguridad en los almacenes.

Fourier está aprovechando a Isaac Sim para entrenar a robots humanoides para operar en campos que exigen altos niveles de interacción y adaptabilidad, como la investigación científica, el área de la salud y la manufactura.

Usando a Isaac Lab e Isaac Sim, Galbot avanzó en el desarrollo de un conjunto de datos de agarre diestro robótico a gran escala llamado DexGraspNet que se puede aplicar a diferentes manos robóticas diestras, así como un entorno de simulación para evaluar modelos de agarre diestro.

Field AI desarrolló modelos de cimentación multitarea y multipropósito delimitados por el riesgo para que los robots operen de manera segura en entornos de campo al aire libre, utilizando la plataforma Isaac y el Isaac Lab.

La era de la IA física ya está aquí, y está transformando las industrias pesadas y la robótica del mundo.

Comienza a usar NVIDIA Robotics.