El 2025 marcó un año decisivo para el desarrollo de la IA en PC.

Los modelos de lenguaje pequeño (SLM) para PC mejoraron su precisión casi dos veces con respecto a 2024, reduciendo drásticamente la brecha con los modelos de lenguaje grande (LLM) basados en la nube. Las herramientas de desarrollo de PC con IA, como Ollama, ComfyUI, llama.cpp y Unsloth, han madurado, su popularidad en se ha duplicado año tras año y el número de usuarios que descargan modelos para PC se ha multiplicado por diez desde 2024.

Estos avances están allanando el camino para que la IA generativa se adopte de forma generalizada entre los creadores, jugadores y usuarios productivos que utilizan PC a diario este año.

En el CES de esta semana, NVIDIA anuncia una serie de actualizaciones de IA para los dispositivos GeForce RTX, NVIDIA RTX PRO y NVIDIA DGX Spark que liberan el rendimiento y la memoria necesarios para que los desarrolladores implementen la IA generativa en PC, entre las que se incluyen:

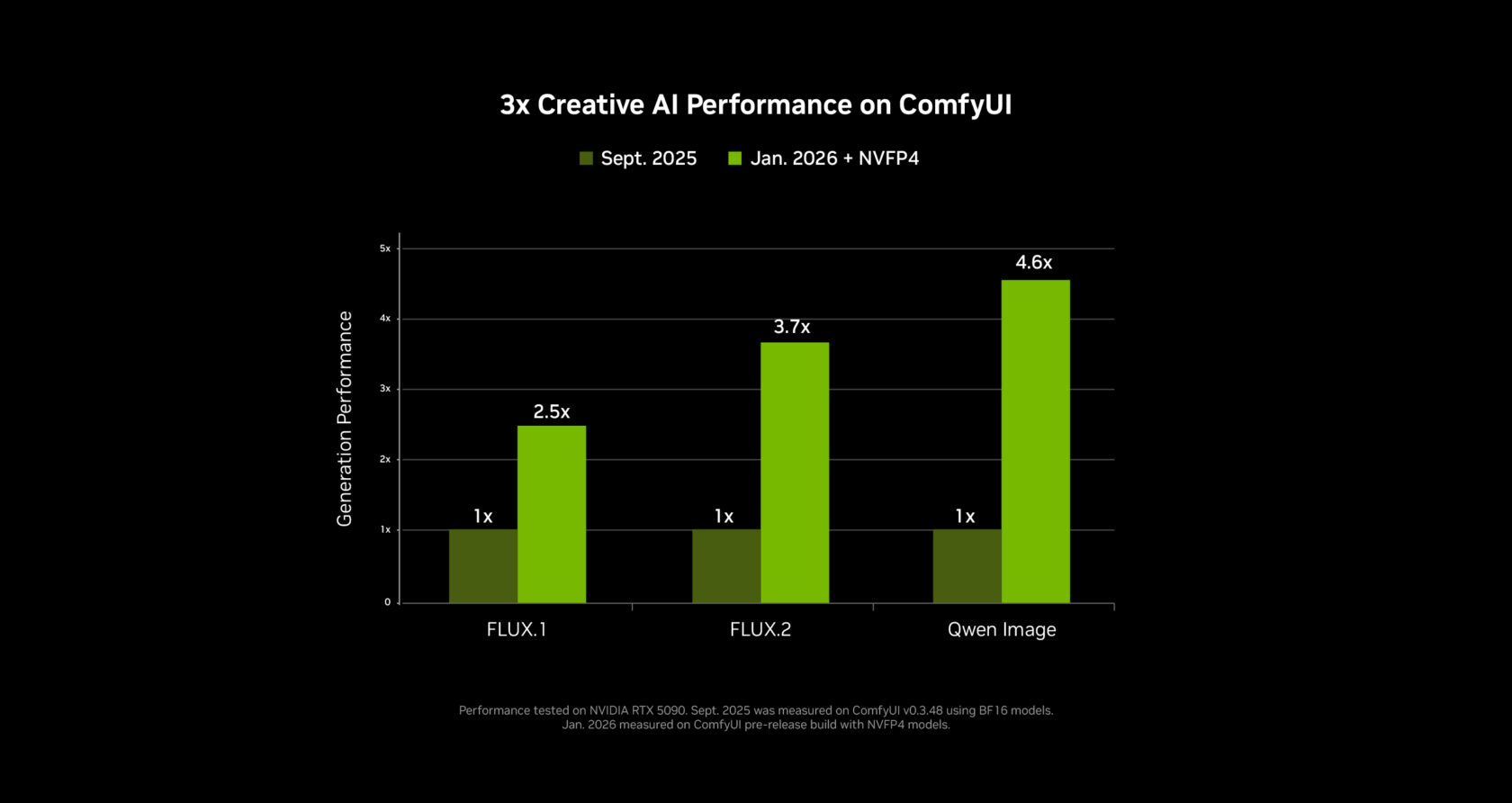

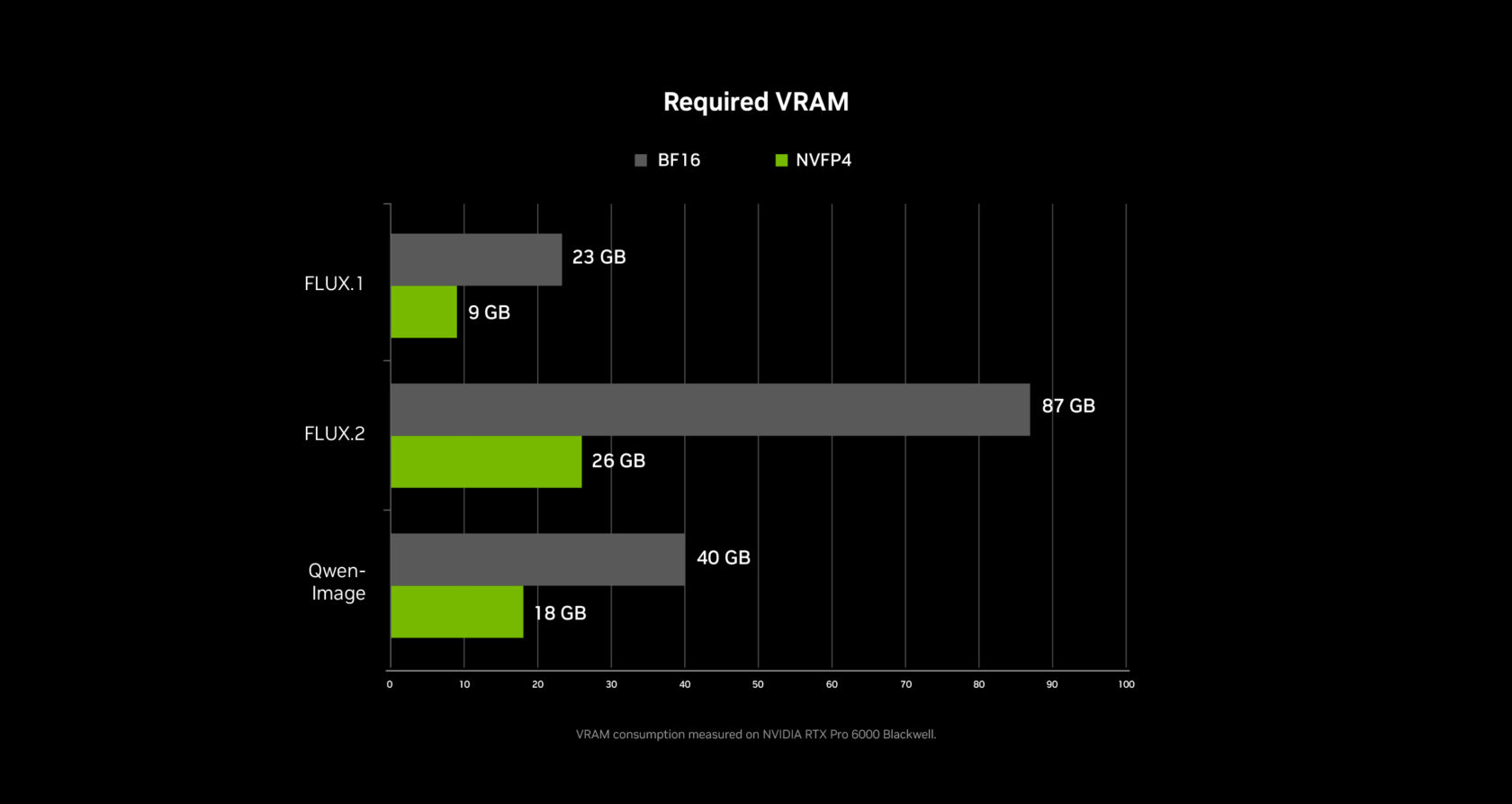

- Hasta tres veces más rendimiento y una reducción del 60 % en la VRAM para la IA generativa de video e imágenes gracias a las optimizaciones de PyTorch-CUDA y la compatibilidad nativa con la precisión NVFP4/FP8 en ComfyUI .

- Integración de RTX Video Super Resolution en ComfyUI, lo que acelera la generación de video 4K.

- Optimizaciones NVIDIA NVFP8 para el lanzamiento de pesos abiertos del modelo de generación de audio y video LTX-2 de última generación de Lightricks.

- Una nueva canalización de generación de video para generar video 4K con IA utilizando una escena 3D en Blender para controlar con precisión los resultados.

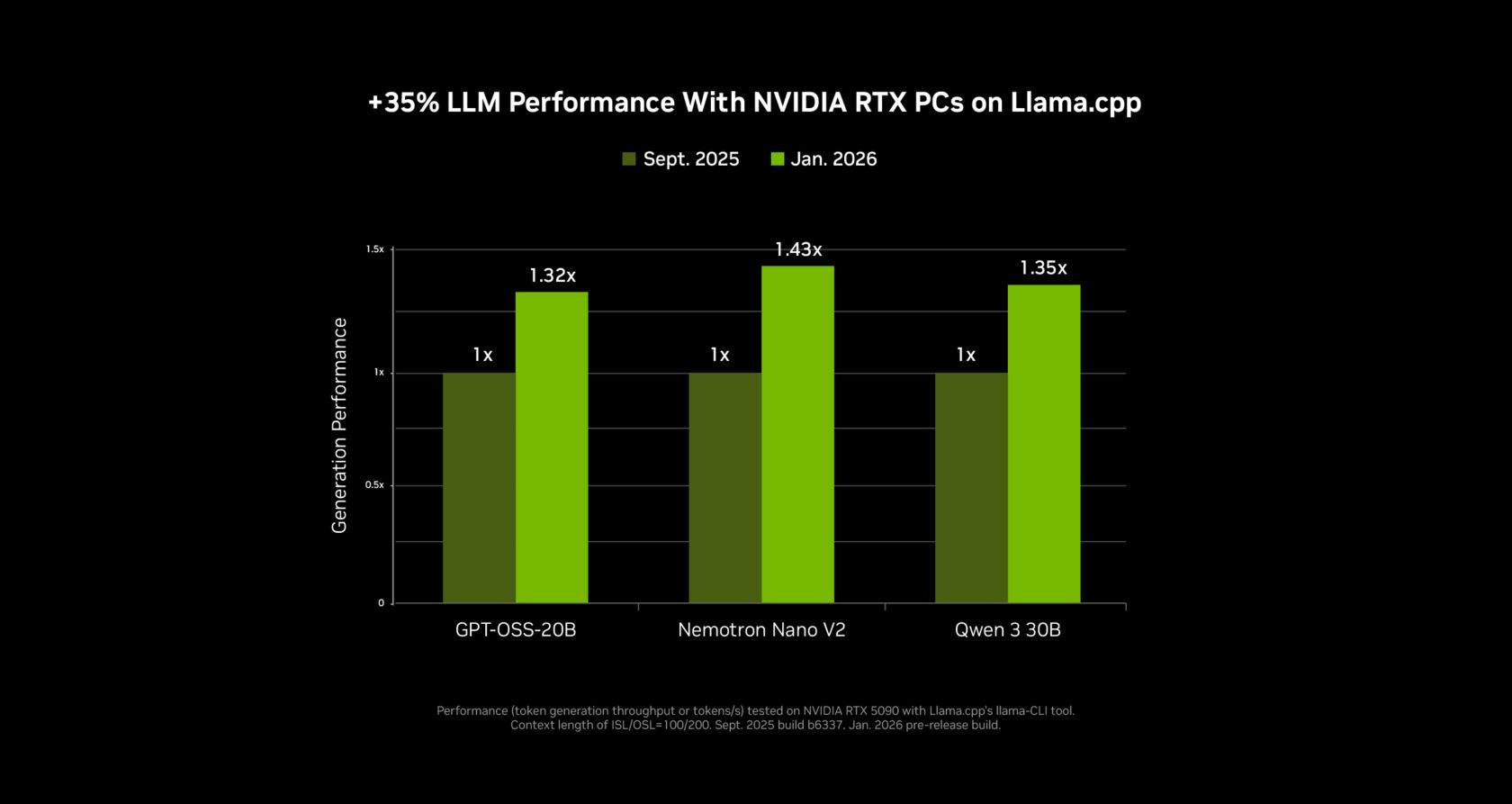

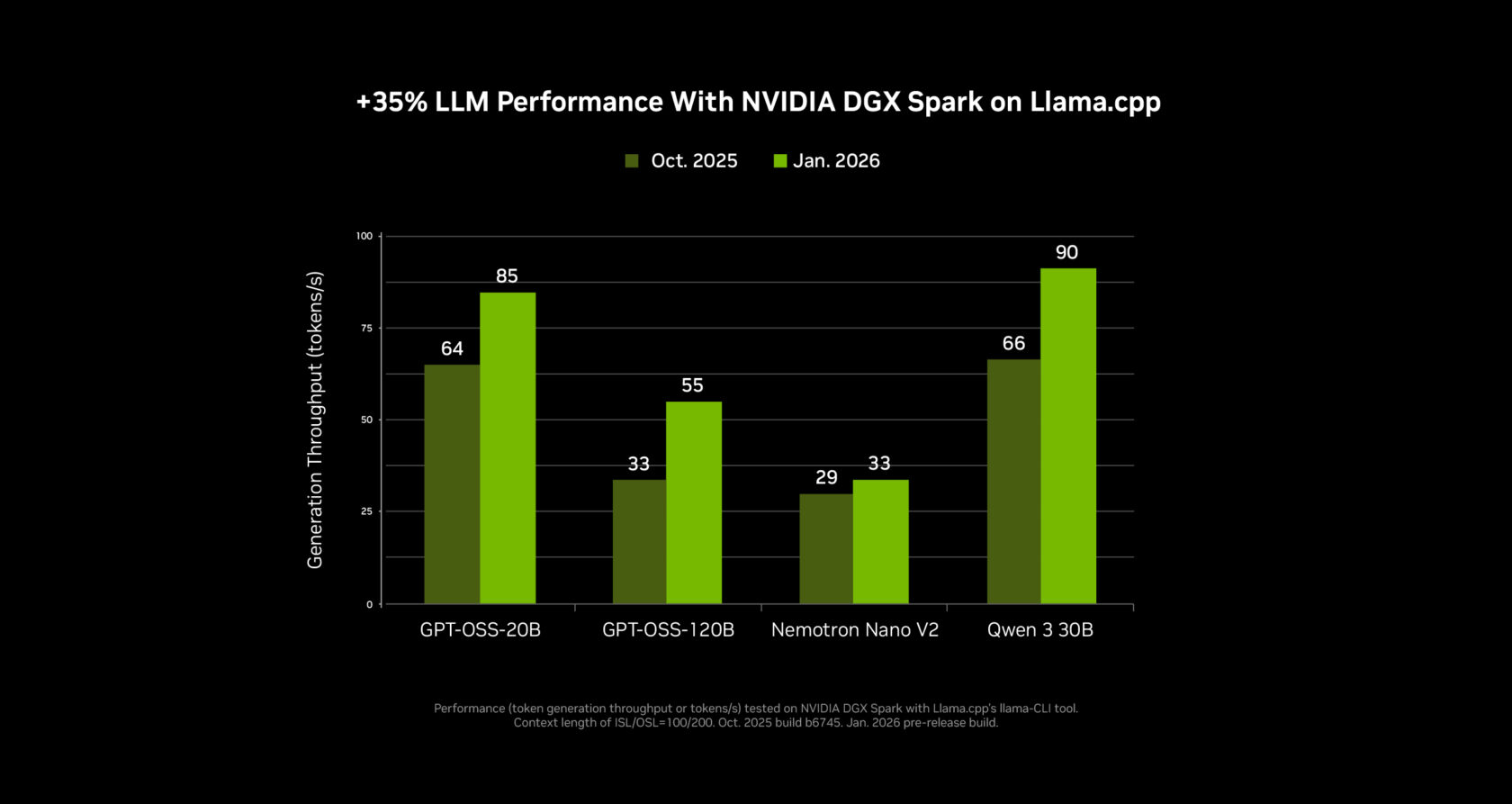

- Rendimiento de inferencia hasta un 35 % más rápido para SLM a través de Ollama y llama.cpp.

- Aceleración RTX para Nexa.ai y la nueva función de búsqueda de video Hyperlink.

Estos avances permitirán a los usuarios ejecutar sin problemas flujos de trabajo avanzados de IA de video, imagen y lenguaje con la privacidad, la seguridad y la baja latencia que ofrecen las PC locales con RTX AI.

Genere videos tres veces más rápido y en 4K en PCs RTX

La IA generativa puede crear videos increíbles, pero las herramientas en línea pueden ser difíciles de controlar solo con indicaciones. Y tratar de generar videos 4K es casi imposible, ya que la mayoría de los modelos son demasiado grandes para caber en la VRAM de la PC.

Hoy, NVIDIA presenta un canal de generación de video con tecnología RTX que permite a los artistas obtener un control preciso sobre sus generaciones, al tiempo que generan videos tres veces más rápido y los escalan a 4K, utilizando solo una fracción de la VRAM.

Este proceso de video permite a los artistas emergentes crear un guion gráfico, convertirlo en fotogramas clave fotorrealistas y, a continuación, convertir estos fotogramas clave en un video 4K de alta calidad. El proceso se divide en tres planos que los artistas pueden mezclar y combinar o modificar según sus necesidades:

- Un generador de objetos 3D que crea recursos para las escenas.

- Un generador de imágenes guiado por 3D que permite a los usuarios configurar su escena en Blender y generar fotogramas clave fotorrealistas a partir de ella.

- Un generador de video que sigue los fotogramas clave inicial y final del usuario para animar su video, y utiliza la tecnología NVIDIA RTX Video para escalarlo a 4K.

Este proceso es posible gracias al lanzamiento revolucionario del nuevo modelo LTX-2 de Lightricks, disponible para su descarga desde hoy.

LTX-2, un hito importante para la creación de videos con IA local ofrece resultados que están a la altura de los principales modelos basados en la nube, al tiempo que genera hasta 20 segundos de video 4K con una fidelidad visual impresionante. El modelo cuenta con audio integrado, compatibilidad con múltiples fotogramas clave y capacidades de acondicionamiento avanzadas mejoradas con adaptaciones de bajo rango controlables, lo que proporciona a los creadores una calidad y un control de nivel cinematográfico sin depender de la nube.

En segundo plano, el proceso está impulsado por ComfyUI. Durante los últimos meses, NVIDIA ha trabajado en estrecha colaboración con ComfyUI para optimizar el rendimiento en un 40% en las GPUs NVIDIA, y la última actualización agrega compatibilidad con los formatos de datos NVFP4 y NVFP8. En conjunto, el rendimiento es tres veces más rápido y la VRAM se reduce en un 60 % con el formato NVFP4 de la serie RTX 50, y el rendimiento es dos veces más rápido y la VRAM se reduce en un 40% con NVFP8.

Los puntos de control NVFP4 y NVFP8 ya están disponibles para algunos de los modelos más destacados directamente en ComfyUI. Entre estos modelos se incluyen LTX-2 de Lightricks, FLUX.1 y FLUX.2 de Black Forest Labs, y Qwen-Image y Z-Image de Alibaba. Descárgalos directamente en ComfyUI. Próximamente habrá compatibilidad con más modelos.

Una vez generado un videoclip, los videos se escalan a 4K en solo unos segundos utilizando el nuevo nodo RTX Video en ComfyUI. Este escalador funciona en tiempo real, afina los bordes y limpia los artefactos de compresión para obtener una imagen final nítida. RTX Video estará disponible en ComfyUI el próximo mes.

Para ayudar a los usuarios a superar los límites de la memoria de la GPU, NVIDIA ha colaborado con ComfyUI para mejorar su función de descarga de memoria, conocida como “weight streaming”. Con el “weight streaming” habilitado, ComfyUI puede utilizar la RAM del sistema cuando se agota la VRAM, lo que permite modelos más grandes y gráficos de nodos multietapa más complejos en GPUs RTX de gama media.

El flujo de trabajo de generación de video estará disponible para su descarga el próximo mes, y las nuevas actualizaciones de LTX-2 Video Model y ComfyUI RTX ya están disponibles.

Una nueva forma de buscar archivos y videos en la PC

La búsqueda de archivos en las computadoras ha sido la misma durante décadas. Sigue basándose principalmente en los nombres de los archivos y en metadatos irregulares, lo que hace que localizar ese documento del año pasado sea mucho más difícil de lo que debería ser.

Hyperlink, el agente de búsqueda local de Nexa.ai, convierte las computadoras RTX en una base de conocimientos con capacidad de búsqueda que puede responder a preguntas en lenguaje natural con citas en línea. Puede escanear e indexar documentos, diapositivas, PDF e imágenes, de modo que las búsquedas pueden basarse en ideas y contenidos en lugar de en conjeturas sobre los nombres de los archivos. Todos los datos se procesan localmente y permanecen en la computadora del usuario de para garantizar la privacidad y la seguridad. Además, está acelerado por RTX, lo que permite indexar archivos de texto e imagen en 30 segundos por gigabyte y obtener una respuesta en tres segundos con una GPU RTX 5090, en comparación con una hora por gigabyte para indexar archivos y 90 segundos para obtener una respuesta con CPU.

En el CES, Nexa.ai presenta una nueva versión beta de Hyperlink que agrega compatibilidad con contenido de video, lo que permite a los usuarios buscar objetos, acciones y discursos en sus videos. Esto es ideal para usuarios que van desde artistas de video que buscan material de archivo hasta jugadores que quieren encontrar ese momento en el que ganaron una partida de battle royale para compartirlo con sus amigos.

Si está interesado en probar la versión beta privada de Hyperlink, regístrese en esta página web para obtener acceso. El acceso se habilitará a partir de este mes.

Los modelos de lenguaje pequeños se vuelven un 35% más rápidos

NVIDIA ha colaborado con la comunidad de código abierto para ofrecer importantes mejoras de rendimiento para los SLM en las GPU RTX y el superordenador de escritorio NVIDIA DGX Spark utilizando Llama.cpp y Ollama. Los últimos cambios son especialmente beneficiosos para los modelos de mezcla de expertos, incluida la nueva familia de modelos abiertos NVIDIA Nemotron 3.

El rendimiento de la inferencia de SLM ha mejorado un 35% y un 30% para llama.cpp y Ollama, respectivamente, en los últimos cuatro meses. Estas actualizaciones ya están disponibles, y una mejora de la calidad de vida para llama.cpp también acelera los tiempos de carga de LLM.

Estas mejoras de velocidad estarán disponibles en la próxima actualización de LM Studio y pronto llegarán a aplicaciones agenticas como la nueva aplicación MSI AI Robot. La aplicación MSI AI Robot, que también aprovecha las optimizaciones de Llama.cpp, permite a los usuarios controlar la configuración de sus dispositivos MSI e incorporará las últimas actualizaciones en una próxima versión.

NVIDIA Broadcast 2.1 lleva Virtual Key Light a más usuarios de PC

La aplicación NVIDIA Broadcast mejora la calidad del micrófono y la cámara web del PC del usuario con efectos de IA, ideales para transmisiones en vivo y videoconferencias.

La versión 2.1 actualiza el efecto Virtual Key Light para mejorar el rendimiento, haciéndolo disponible para las GPU de escritorio RTX 3060 y superiores, manejar más condiciones de iluminación, ofrecer un control más amplio de la temperatura del color y utilizar un mapa base HDRi actualizado para un estilo de dos luces que se ve a menudo en las transmisiones profesionales. Descarga hoy mismo la actualización de NVIDIA Broadcast.

Transforma tu estudio creativo en casa en una potencia de IA con DGX Spark

A medida que cada mes llegan a las computadoras nuevos modelos de IA cada vez más capaces, sigue creciendo el interés de los desarrolladores por configuraciones de IA locales más potentes y flexibles. DGX Spark, una supercomputadora de IA compacta que cabe en el escritorio de los usuarios y se conecta a la perfección con una computadora de escritorio o portátil principal, permite experimentar, crear prototipos y ejecutar cargas de trabajo de IA avanzadas junto con una computadora existente.

Spark es ideal para aquellos interesados en probar LLM o crear prototipos de flujos de trabajo agenticos, o para artistas que desean generar activos en paralelo a su flujo de trabajo, de modo que su PC principal siga estando disponible para la edición.

En el CES, NVIDIA presenta importantes actualizaciones del rendimiento de IA de Spark, que ofrece un rendimiento hasta 2.6 veces más rápido desde su lanzamiento hace poco menos de tres meses.

También hay disponibles nuevos manuales de DGX Spark, incluido uno para la decodificación especulativa y otro para ajustar modelos con dos módulos DGX Spark.

Conéctese a NVIDIA AI PC en Facebook, Instagram, TikTok y X, y manténgase informado suscribiéndose al boletín de RTX AI PC. Siga a NVIDIA Workstation en LinkedIn y X.

Consulte el aviso sobre la información del producto de software.